Denkt man an Online-Speicher oder Datenaustausch, fällt unweigerlich der Begriff „Cloud Computing“. Weniger bekannt hingegen ist „Edge Computing“. Was verbirgt sich dahinter? Infineon bietet Sensoren und Aktuatoren für Edge Devices in den unterschiedlichsten Anwendungen.

Was ist Edge Computing?

Als „Edge“ bezeichnet man im Bereich Computing den äußersten Rand eines technischen Informationsnetzwerks, an dem die virtuelle Welt eines Computernetzwerks auf die reale Welt trifft. Meist impliziert der Begriff „Edge“, dass es sich bei dem Netzwerk um das Internet handelt.

Zusammenhang zwischen Edge Computing und Cloud Computing

Der Begriff „Edge Computing“ (auf Deutsch: Kante) ist untrennbar mit dem Begriff „Cloud Computing“ verbunden. Als „Cloud“ (auf Deutsch: Wolke) wird die Gesamtheit der global über das Internet verteilten zentralen Recheneinheiten bezeichnet. Diese, auch Server genannten Recheneinheiten interagieren selbst nicht direkt mit der realen Welt, sondern sind über das Netzwerk untereinander und mit den Geräten an der Edge verbunden. Diese Geräte tragen die Bezeichnung „Edge Devices“.

Beispiele für typische Edge Devices

Als Edge Device kann man jegliche Art von vernetzen intelligenten Systemen betrachten, die mit Mikrokontrollern, Sensorik und/oder Aktuatorik ausgestattet sind. Meist firmieren diese Systeme unter Begriffen, wie „Smart City“, „Smart Grid“, „Smart Building“ und „Industrial IoT“.

Zu Edge Devices gehören hochintegrierte Systeme für sehr spezifische Aufgaben, wie vernetzte

- Heizungsthermostate

- Küchengeräte

- Stromzähler

- Sprachassistenten

- Fernsehgeräte

- Mobiltelefone

Der Begriff Edge wird meist sehr breit ausgelegt und man kann sogar jegliche Art von voll- oder teilautonomen Fahrzeugen, wie Autos oder Drohnen, als Edge Devices betrachten.

Die Maker Szene bietet zahlreiche Plattformen, die sich für Edge-Anwendungen eignen. Der Einplatinencomputer „Einplatinencomputer von Raspberry PI“, beispielsweise, stellt einen vollwertigen, auf Linux basierten Internetknoten dar. Für einfachere Anwendungen dient auch ein „Board von Arduino“. Beide Plattformen werden gerne auch in Prototypen für kommerzielle Anwendungen eingesetzt.

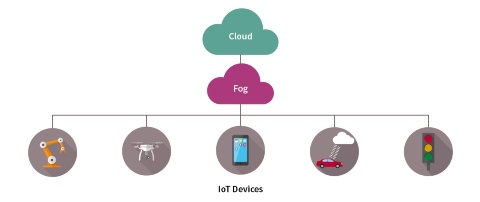

Die Server sind in Computerfarmen organisiert und dabei gibt es in der Regel keine feste Zuordnung zwischen Servern und Edge Devices. Die Rechenleistung wird sozusagen aus einer diffusen Wolke von anonymen Servern erbracht. Deshalb spricht man hier von „Cloud Computing“. Datenverarbeitung kann aber auch bereits in den Edge Devices erfolgen, was dementsprechend als „Edge Computing“ bezeichnet wird.

Der Übergang zwischen „Edge“ und „Cloud“ ist fließend. Zusätzliche Rechenleistung kann auch nahe an der Edge angesiedelt sein, ohne direkt mit einem Sensor oder Aktuator verbunden zu sein. Diese Art der Datenverarbeitung wird oft auch als „Fog Computing“ (auf Deutsch: Nebel Computing) bezeichnet.

Welche Sensoren und Aktuatoren gibt es für Edge Devices?

Je nach Anwendung sind Edge Devices mit den verschiedensten Sensoren und Aktuatoren ausgestattet.

- Mikrophone zu erkennen von Worten und Sprache, Lokalisierung und Erkennung von Sprechern und Geräuschen. Zur Produkt-Seite: MEMS Mikrofone

- Optische Kameras zum Lokalisieren und Erkennen von Personen und Objekten

- Radar zum Erfassen von Abständen, Geschwindigkeiten, Klassifizieren von Objekten und Gesten. Zur Produkt-Seite: Radar Sensoren

- Time-Of-Flight zur 3D Erfassung von Objekten und Authentisierung von Personen. Zur Produkt-Seite: ToF (Time-Of-Flight)

- Beleuchtungs- und Näherungssensoren

- Hall Sensoren zur Erfassung von Magnetfeldern und elektrischen Strömen

- Bewegungssensoren zur Erfassung von Beschleunigung, Geschwindigkeit und Position

- Barometrische Drucksensoren zur Wettervorhersage, Höhenmessung. Zur Produkt-Seite: Durcksensoren

- Physikalisch/chemische Sensoren zur Ermittlung der Zusammensetzung von Flüssigkeiten und Gasen

Wie funktioniert „Edge Computing“?

An der „Edge“ befinden sich Sensoren und Aktuatoren. Sensoren erfassen die reale Welt. Aktuatoren manipulieren sie. Analoge Messdaten werden an der Edge in digitale Parameter konvertiert und digitale Stellgrößen werden in analoge Ausgangssignale gewandelt.

Edge Computing bedeutet, dass erfasste Daten nicht erst zur zentralen Verarbeitung auf einem Server weitergeleitet, sondern bereits an Ort und Stelle verarbeitet werden. So kann ein Mikroprozessor direkt aus den erfassten Messdaten entsprechende Aktionen ableiten und die Aktuatoren ansteuern.

Beispiele für Aktuatoren

- Ein Temperatursensor erfasst die Raumtemperatur und schaltet anschließend – je nach Regelalgorithmus und Zieltemperatur – eine Heizung ein- oder aus.

- Ein Winkel- oder Abstandssensor erfasst eine Position und steuert einen Motor entsprechend an.

Was ist ein „Embedded System“?

Als „Embedded System“ bezeichnet man üblicherweise ein integriertes System aus Sensoren, Aktuatoren, Analog-/Digital-Wandlung und einen Prozessor. In Form eines Edge Device besitzt das Embedded System überdies ein Kommunikations- oder Netzwerkinterface zur Cloud. Darüber können erfasste oder lokal vorverarbeitete Daten zu zentralen Servern übermittelt bzw. Befehle und Konfigurationsdaten empfangen werden.

Neue Anwendungen durch Künstliche Intelligenz (KI)

Der Begriff „Edge Computing“ hat sich erst in den letzten Jahren mit der vermehrten Anwendung von Künstlicher Intelligenz (KI) bzw. Neuronalen Netzen etabliert.

Die breite Verfügbarkeit von Daten und Rechenleistung in der „Cloud“ hat zu großen Fortschritten im Bereich der Künstlichen Intelligenz und des maschinellen Lernens geführt. Man kann mit der in der Cloud nahezu unbegrenzt verfügbaren Datenverarbeitungskapazität heute immer umfangreichere Künstliche Neuronale Netze für anspruchsvolle Aufgaben trainieren. Maschinell gelernte Algorithmen haben zu Durchbrüchen in den verschiedensten Bereichen geführt. Dazu gehören:

- Erkennung und Verarbeitung natürlicher Sprache

- Texterkennung und Textgenerierung

- Klassifizierung und Verfolgung von Objekten mit bildgebenden Sensoren

- Erkennung von Mustern und Vorhersage von Trends in großen Datensätzen

- Authentisierung von Personen aufgrund biometrischer Merkmale

Künstliche Neuronale Netze setzen sich aus mehreren Schichten künstlicher Neuronen zusammen. Diese Neuronen vernetzen sich untereinander über Synapsen. Man unterscheidet zwischen Eingabe-Schicht, verborgenen Schichten und Ausgabe-Schicht (Input/Hidden/Output-Layer). Die künstlichen Neuronen bilden dabei in der Regel nur sehr abstrakt das Verhalten biologischer Neuronen ab. Überschreiten die gewichteten und akkumulierten Anregungen an den Synapsen eine bestimmt Schwelle, sendet das Neuron seinerseits eine Anregung an die nächste Schicht von Neuronen aus. Beim Trainieren eines Neuronalen Netzwerks werden über einen Lernalgorithmus mittels umfangreicher Trainingsdaten schrittweise die Gewichte für die Synapsen festgelegt.

Künstliche Neuronale Netze können über mehrere Millionene Neuronen und Milliarden Synapsen verfügen. Das Trainieren für eine bestimmte Aufgabe ist selbst auf leistungsstarken Servern zeitintensiv und kann mitunter Tage oder Wochen dauern. Da liegt es auf den ersten Blick nahe, Künstliche Intelligenz (KI) ausschließlich in der Cloud anzusiedeln.

Jedoch braucht man für das reine ausführen (die sog. „Inference“) trainierter Neuronaler Netze wesentlich weniger Rechenleistung as für das Trainiren selbst. Diese Tatsache zusammen mit modernen hardwarefreundlichen Netzwerkarchitekturen und Tools für das effiziented abbilden solcher Netze auf „Embedded Systems“ erlauben es viele Anwendungen der Künstlichen Intelligenz (KI) auch direkt an der Edge auszuführen.

Sicherheit für Edge Devices

Ein zentraler Aspekt von Edge Computing ist die Datensicherheit. Nur bestimmte Daten dürfen das System verlassen, während andere in Edge Device verbleiben müssen. Um das zu gewährleisten, wird die Integrität des Edge Devices fortlaufend überprüft. Es wird insbesondere überwacht, ob dessen Systemsoftware manipuliert wurde. Bei geplanten Updates der Systemsoftware muss deren Originalität verifiziert werden.

Für die Kommunikation mit der Cloud muss das Edge Device erst die Authentizität des Servers bzw. Datendienstes überprüfen und dann die Daten verschlüsselt übermitteln. Das wird heute über Verfahren der asymmetrischen Kryptographie ermöglicht und durch eine Infrastruktur zur Verteilung von öffentlichen Schlüsseln („Public Key Infrastructure“) unterstützt.

Dabei ist es wichtig, dass die Sicherheit in Hardware begründet ist, denn diese ist nicht so leicht manipulierbar wie Software. Infineon bietet speziell für Edge Devices sogenannte „Embedded Trusted Platform Module“ an. Damit können die Integrität des Systems sichergestellt, die Authentizität von Kommunikationspartnern überprüft und Daten sicher verschlüsselt werden.

Infineon und Edge Computing

Eine Vielzahl von Edge Devices setzen Sensoren, Mikrokontroller, Sicherheitslösungen und Leistungselektronik von Infineon ein. Neben Halbleiterkomponenten und mikromechanischen Sensoren bietet das Technologieunternehmen auch in Zusammenarbeit mit mittelständischen Partnern komplette Subsysteme und Geräte im Bereich Edge Computing an.

Beispiel: Innovatives Alarmsystem

Das neuartige Alarmsystem von Infineon ist ein gutes Anwendungsbeispiel dafür, wie Edge-Computing-Lösungen bestehende Smart-Home-Systeme bereichern. Während Mikrofone bisheriger Alarmsysteme den Glasbruch beim widerrechtlichen Eindringen in eine Wohnung erkennen, wertet das von Infineon zum Patent angemeldete Konzept mittels Neuronaler Netze eine Kombination aus Audio- und Druckinformationen aus.

Auf diese Weise wird die Anzahl an Fehlalarmen minimiert und die Zuverlässigkeit des Systems signifikant erhöht. Eine weitere Stärke des neuen Alarmsystems ist die flexible Implementierung: Die Infineon-Lösung lässt sich einfach in bereits bestehende Glasbruchmeldeanlagen integrieren.

Fazit

Edge Computing dringt mehr und mehr in alle Bereiche unseres Lebens vor. Sensoren, Aktuatoren und die zugehörige Leistungselektronik sind die Schnittstellen des Edge Devices und damit des gesamten Netzwerkes zur realen Welt. Mit Edge Computing können Daten lokal verarbeitet und – nur das, was nötig ist – in die Cloud übertragen werden. Erforderliche Rechenleistung, Energieeffizienz und Latenzzeiten sowie Sicherheit und Privatspäre entscheiden letztlich darüber, wo die Daten am besten in der Edge oder in der Cloud verarbeitet werden. Beide Lösungen ergänzen sich. Algorithmen auf Basis künstliche Neuronale Netze sind nicht nur der Cloud vorbehalten, sondern können vor Ort intelligente Entscheidungen treffen und ermöglichen bahnbrechende neue Anwendungen. Ihr Siegeszug hat gerade erst begonnen.

Letzte Aktualisierung: Dezember 2019